KI-Sicherheit

Normung

Die Normung im KI Bereich

Im Bestreben der Regulierung Künstlicher Intelligenz hat die Europäische Kommission bereits am 22. Mai 2023 einen Durchführungsbeschluss über einen Normungsauftrag an die Europäischen Normungsorganisationen erlassen. Ziel dieses Rechtsakts ist es, anhand von technischen Normen wesentliche Aspekte im Zusammenhang mit KI-Anwendungen zu regeln. Darunter zählen etwa die Bereiche Transparenz, Qualitäts- und Risikomanagement, Aufzeichnung durch Protokollierungsfunktionen von KI Systemen aber etwa auch zu Menschlicher Aufsicht über KI-Systemen.

Am 21. Mai 2024 hat der Europäische Gesetzgeber schließlich den AI Act als rechtliche Grundlage zur Regulierung von KI Systemen verabschiedet.

Der AI Act

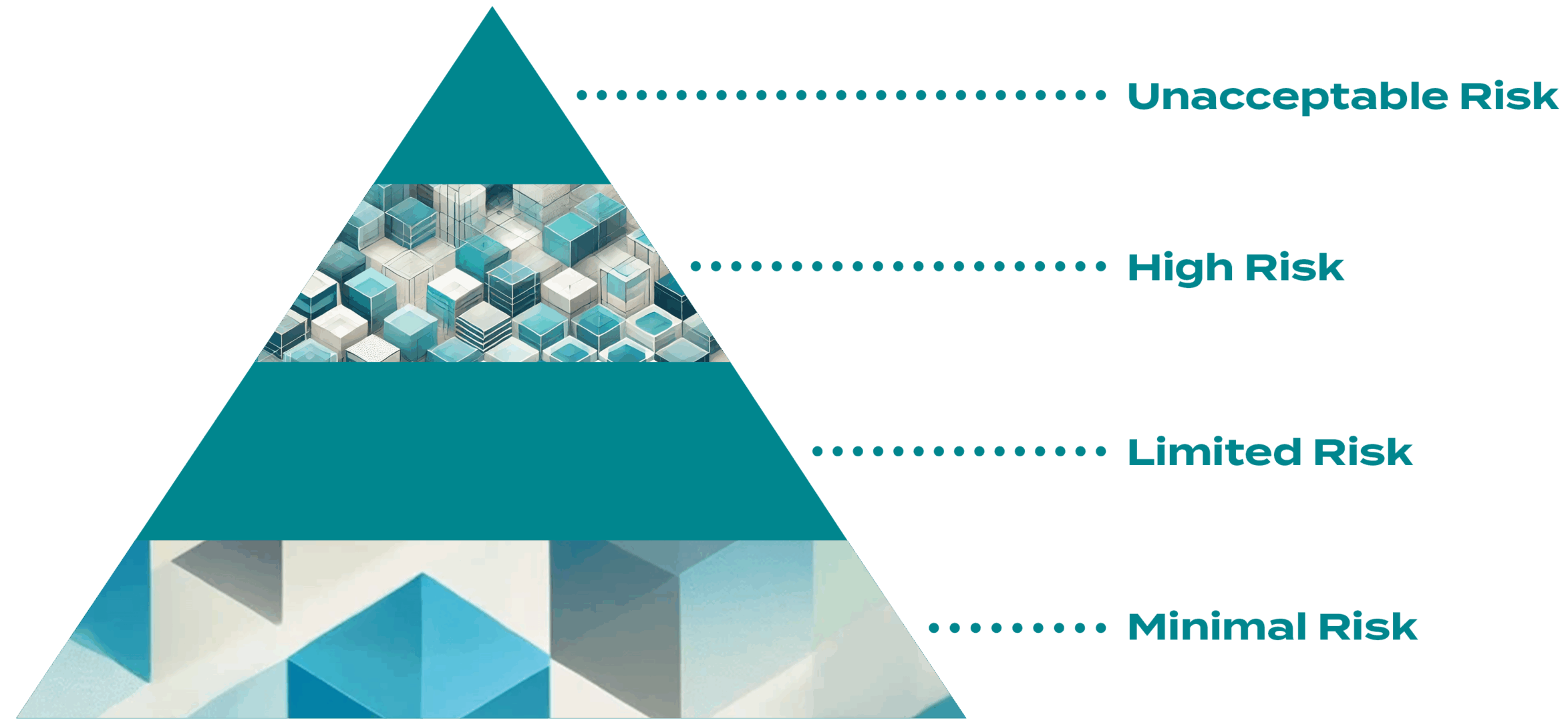

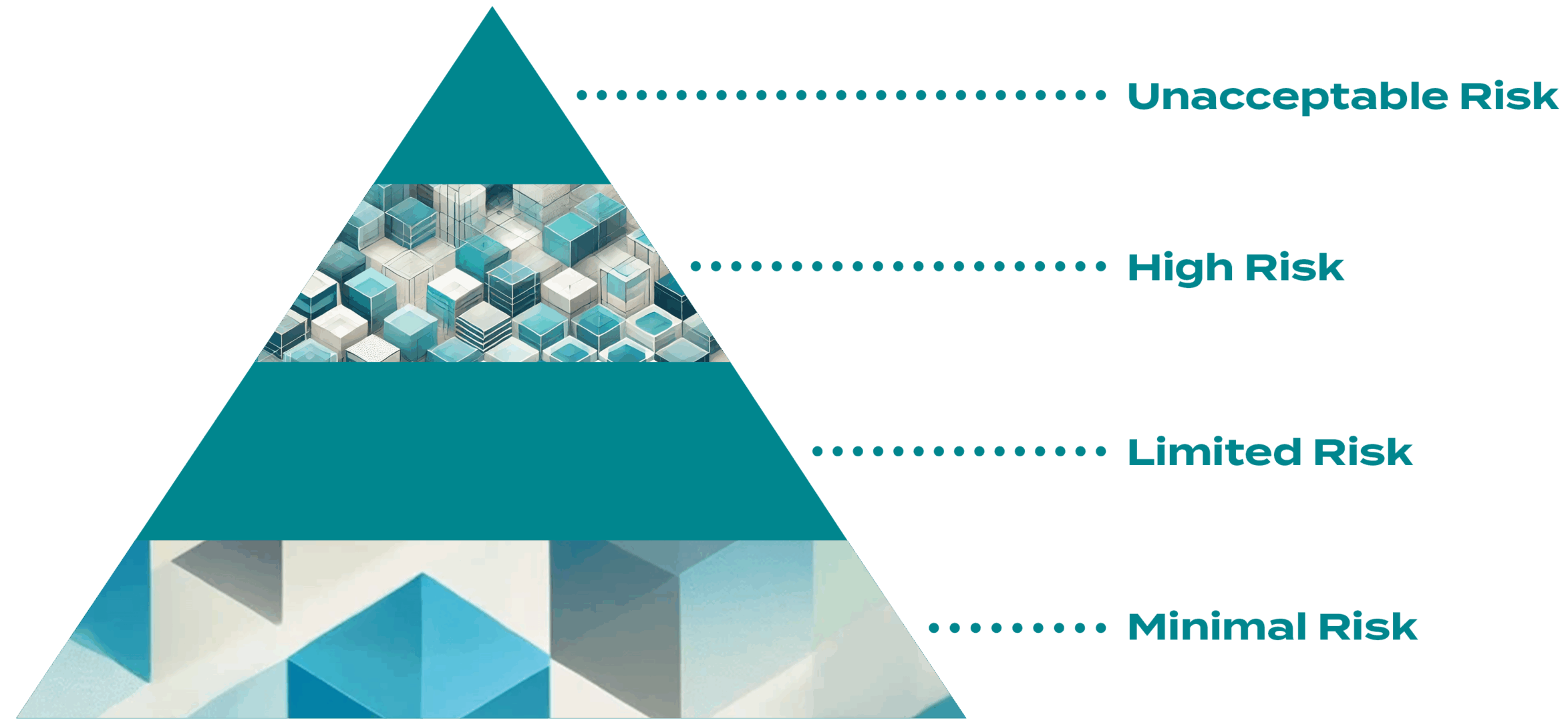

Der AI Act ist der erste Rechtsrahmen für KI-Systeme und adressiert dabei KI-Entwickler und -Bereitsteller. Kernstück des AI Act ist die Einstufung von KI Systemen in vier Risikostufen (von inakzeptablem Risiko bis minimalem Risiko), wobei diese Einstufung im Lichte bzw. vergleichbar eines Produktsicherheitsrisikos erfolgt und als horizontale Regulierung sektorübergreifend gewisse grundlegende rechtliche Vorgaben für den Einsatz von KI-Systemen festschreibt. Je nach Risikogruppe sind für die Betreiber bestimmte Vorgaben definiert, welche von diesen zu erfüllen sind.

Diesem Produktsicherheitsgedanken folgend werden KI-Anwendungen je nach Risiko ihrer möglichen Auswirkungen auf die Gesundheit, die Sicherheit und die Grundrechte von mit diesen KI-Systemen konfrontierten Anwender:innen in die vorgegebenen vier Risikostufen eingeordnet. Eine besondere Rolle spielen dabei insbesondere die zwei höchsten Risikostufen. So finden sich in Stufe vier KI-Anwendungen mit einem „inakzeptablem Risiko“, deren Einsatz seit Februar 2025 im Unionsgebiet untersagt ist. Dazu zählen beispeilsweise KI Systeme, die vorhersagen wie hoch die Wahrscheinlichkeit ist, dass eine bestimmte Person eine Straftat begehen wird.

In Stufe drei werden sogenannte hoch-Risiko-Systeme definiert. Dies trifft etwa auf KI in Bildungseinrichtungen und in der Strafverfolgung sowie KI, die die Sicherheit kritischer Infrastrukturen wie den Verkehr regelt, zu.

Diesem Produktsicherheitsgedanken folgend werden KI-Anwendungen je nach Risiko ihrer möglichen Auswirkungen auf die Gesundheit, die Sicherheit und die Grundrechte von mit diesen KI-Systemen konfrontierten Anwender:innen in die vorgegebenen vier Risikostufen eingeordnet. Eine besondere Rolle spielen dabei insbesondere die zwei höchsten Risikostufen. So finden sich in Stufe vier KI-Anwendungen mit einem „inakzeptablem Risiko“, deren Einsatz seit Februar 2025 im Unionsgebiet untersagt ist. Dazu zählen beispeilsweise KI Systeme, die vorhersagen wie hoch die Wahrscheinlichkeit ist, dass eine bestimmte Person eine Straftat begehen wird.

In Stufe drei werden sogenannte hoch-Risiko-Systeme definiert. Dies trifft etwa auf KI in Bildungseinrichtungen und in der Strafverfolgung sowie KI, die die Sicherheit kritischer Infrastrukturen wie den Verkehr regelt, zu.

Welche Rolle spielt dabei die technische Normung?

Der AI Act wurde im Rahmen des New Legislative Framework erlassen. Nach diesem System wurden durch den europäischen Gesetzgeber die wesentlichen rechtlichen Vorgaben für die KI-Entwickler und -Bereitsteller je nach Risikostufe der KI-Anwendung festgelegt. Die Frage wie diese rechtlichen Vorgaben bestmöglich erfüllt werden können, sollte anhand von technischen Normen erfolgen.

Zu diesem Zweck hat die Europäische Kommission einen offiziellen Normungsauftrag (einen sog. Standardization Request) an die europäischen Normungsorganisationen Cen und CENELEC erlassen. Dieser – ursprünglich eben bereits vor dem AI Act erlassene – Standardization Request gibt die spezifischen Themenbereiche vor, welche durch Normen abgedeckt werden müssen und in der Folge für Hochrisiko-KI-Systeme Anwendung finden. Aufgrund aufgetretener Verzögerungen im Normungsprozess wurde der Normungsauftrag – insbesondere hinsichtlich der Fristen für die Fertigstellung der Normen – adaptiert und im Juni 2025 als Mandat 613 neu erlassen. Trotz dieser Fristerstreckungen befinden sich nach wie vor beinahe sämtliche wesentlichen Normprojekte in Verzug.

Der Normungsprozess

Spätestens bereits seit dem ursprünglichen Normungsauftrag aus 2023 ist es zu einer regelrechten Explosion an Normungsarbeiten und -Tätigkeiten gekommen. So wurde zwischenzeitig an deutlich über 40 verschiedenen Normungsprojekten parallel gearbeitet.

Als die für den Normungsauftrag Wesentlichsten haben sich folgende Projekte herauskristallisiert, die in der Folge auch jene Projekten wurden, mit denen wir uns näher auseinandersetzen:

prEN 18286 „Quality Management System“, die dabei hilft, eine Definition für Qualitätsmanagementsysteme für KIs festzulegen. Die Implementierung eines solchen Qualitätsmanagementsystems sind für Anbieter verpflichtend. Weiters gibt die Norm vor, wie diese Systeme anschließend implementiert, verwaltet und verbessert werden sollen. Durch diese Norm sollten dabei die Artikel 17 und 72 der KI-Verordnung präzisiert werden.

prEN 18228 „AI Risk Management“: Darin werden die spezifischen Anforderungen zum Thema Risikomanagement geregelt und damit der Artikel 9 der KI Verordnung abgedeckt. Der Normungsentwurf betrifft eine große Gruppe an KI-Produkten und liefert spezifische Methoden um klarzustellen, welche Risikomanagementmaßnahmen für ein bestimmtes Produkt erforderlich sind. Diese reichen vom Miteinbeziehen von schutzbedürftigen Personen, über Gesundheitsrisiken, bis hin zu Marktbeeinflussungen. Alle erforderlichen Maßnahmen müssen über die gesamte Zeitspanne beachtet werden, über die das KI-System betrieben wird.

prEN 18229 „AI trustworthiness framework“, welcher sich um Themen wie Transparenz, menschlicher Aufsicht, Genauigkeit und Robustheit von KI Systemen dreht. Der Standard richtet sich an Unternehmen, die KIs in allen Sektoren auf den Markt bringen. Unter Genauigkeit versteht man die Häufigkeit der richtigen Antworten der KI und unter Robustheit, wie das Modell unter schwierigen Bedingungen wie z.B. der Fahrbahnerkennung bei schlechter Sicht abschneidet. Menschliche Aufsicht bedeutet, dass ein KI System von Menschen eingesehen und im Notfall auch beeinflusst werden kann. Die Transparenz bezieht sich darauf, dass Benutzer wissen sollen, dass sie mit einer KI interagieren und auch die Entscheidungslogik soll nachvollziehbar sein. Das Projekt setzt die Artikel 12 bis 15 und damit gleich eine Reihe von Artikeln der KI Verordnung um. War ursprünglich noch eine harmonisierte Norm angedacht, die diese Themen in sich vereinen sollte, wurde das Projekt im Herbst 2025 in zwei Teile aufgeteilt. Teil eins befasst sich mit der Transparenz und der menschlichen Aufsicht, Teil zwei mit Genauigkeit und Robustheit. Nach einer kurzen Phase der Begutachtung dieser Arbeitsentwürfe über die Weihnachtsfeiertage ist im Frühling 2026 entschieden worden, das Trustworthinessframework auf insgesamt 3 Teile aufzuteilen. Nach derzeitigem Stand sollten diese dann folgende Themen abdecken:

Teil 1: Logging

Teil 2: Genauigkeit und Robustheit

Teil 3: Transparenz und menschliche Aufsicht

Den prEN 18282 „Cybersecurity“, in welchem es um organisatorische und technische Ansätze geht, die die Sicherheit von Hochrisiko KI-Systemen über ihre gesamte Betriebsdauer verbessern sollen. Es werden sowohl allgemeine Themen der Cybersecurity wie das präventive Verhindern oder das Entdecken von Gefahren behandelt, als auch KI spezifische Themen. Dazu zählen Attacken wie das Manipulieren des KI-Datensatzes oder das Eingeben spezieller Inputs, die das Modell zu Fehlern verleiten sollen. Dieser Entwurf setzt den Artikel 15 aus der KI Verordnung um und ist Anfang Mai 2026 zur öffentlichen Begutachtung aufgelegt worden.

Aus dem Blickwinkel des Diskriminierungsschutzes begutachten und begleiten wir zudem prEN 18283 „Bias“, der unter den 10. Artikel der KI Verordnung fällt und eine potenzielle ungewollte Voreingenommenheit behandelt. Sieht ein KI System z.B., dass mehr Männer in technischen Berufen arbeiten, nimmt sie automatisch an, dass Männer auch besser für diese Jobs geeignet wären. Um dem vorzubeugen, muss direkt in den Datensatz des KI Systems eingegriffen werden. Dieser Normungsentwurf erläutert, welche Maßnahmen notwendig sind und wie diese angewendet werden können.

Diese Themen werden im JTC 21 von Cen und Cenelec und in den entsprechenden Spiegelkomitees und Arbeitsgruppen auf nationaler Ebene (bei Austrian Standards insbesondere AG 001.42) be- und erarbeitet.

Welchen Beitrag leistet die Fachstelle?

Ein wichtiger Teil der aktiven Mitgestaltung von Normen ist das Begutachten der einzelnen Arbeitsentwürfe und darauf aufbauend das Einbringen von Kommentaren, mit welchen Verbesserungsvorschläge zu den konkreten Texten formuliert werden.

In diesem Sinne haben wir etwa im Begutachtungsverfahren zur Qualitätsmanagement-Norm gefordert, dass über den gesamten Lebenszyklus eines KI Systems für die jeweiligen Abschnitte klar festgelegt wird, wie die Vorgaben des Qualitätsmanagement-Systems auf den jeweiligen Abschnitt angewendet und implementiert werden sollen. Zudem haben wir uns dafür ausgesprochen, dass zum Schutzes von Gesundheit, Sicherheit und Grundrechten bestimmte Unterstützungsleistungen verpflichtend bereitzustellen sind.

Zu den Arbeitsentwürfen des Trustworthinessframeworks haben wir insbesondere Klarstellungen gefordert, wie beispielsweise die klare Definition von berechtigten Ausnahmen. Daneben sprechen wir uns dafür aus, dass im Bereich der Aufzeichnung von Ereignissen (Logging) nicht nur auf den vorgesehenen Zweck der KI Anwendung abgestellt wird, sondern auch der gesamte Bereich des Einsatzes der KI für Zwecke mit denen vernünftigerweise gerechnet werden kann mitbedacht werden muss.

Zudem haben wir beispielsweise gefordert, dass in den Normenentwurf zu „Bias“ eine Liste mit den am häufigsten vorkommenden unerwünschten Voreingenommenheiten („unwanted biases“) aufgenommen wird. Dazu haben wir angemerkt, dass sich hierfür ein Annex besonders gut eignen würde. Eine solche Liste hätte den Vorteil, dass in einem solchen Sytem KI-Betreiber sich jedenfalls mit den wichtigsten und häufigsten Voreingenommenheiten auseinandersetzen und die Wahrscheinlichkeit deren Vorkommens evaluieren und festhalten müssen. Dadurch sollte zudem auch das Verständnis dafür geschärft werden, was insgesamt unerwünschte Voreingenommenheiten sein können.

Ausblick

Auch vor dem Hintergrund des enormen Zeitdrucks, der durch die Verzögerungen im Normungsprozess entstanden ist, gilt es zu beobachten, inwieweit die in den Begutachtungsverfahren eingebrachten Verbesserungsvorschläge berücksichtigt werden können. Jedenfalls dann, wenn die Begutachtungsentwürfe in der allgemeinen Begutachtungsphase mehrheitlich abgelehnt werden, wie dies zum Beispiel bei der Norm zu den Qualitätsmanagementsystemen Anfang 2026 der Fall war, wird die europäische Arbeitsgruppe gefordert sein, die Verbesserungen aus den Mitgliedsstaaten bereits jetzt in den Texten entsprechend zu berücksichtigen.

Auch wenn durch die Verschiebung des stufenweisen Inkrafttretens der KI Verordnung durch die digitale Omnibus Verordnung die Verspätung der Normen für die Praxis nicht mehr so kritisch ist wie ursprünglich, gilt es jedenfalls weiterhin zu beobachten, ob die Fertigstellung und Veröffentlichung der Normen noch so rechtzeitig gelingt, dass auch eine Harmonisierung der Norm durch Veröffentlichung im Official Journal möglich bleibt.

Jedenfalls werden wir uns über den gesamten noch bevorstehenden Prozess hinweg immer dann konstruktiv mit Verbesserungsvorschlägen einbringen, wenn wir die Entwürfe aus Sicht von Verbraucherinnen und Verbrauchern als nicht zufriedenstellend einstufen.